Hunderttausende Studien sind frei erfunden

Falsche wissenschaftliche Publikationen sind ein schnell wachsendes Problem. Es gibt einen veritablen Markt dafür, und er boomt. Sogenannte «paper mills», Papiermühlen, machen vermutlich Milliardenumsätze. Diese Agenturen bieten Unterstützung für redaktionelle Publikationen, treffender ist der Ausdruck «ghost writing». Man könnte ebenso gut von «fake production» sprechen. Wissenschaftler bezahlen bis zu 25’000 Euro für eine gut gemachte Fälschung oder Erfindung. Die Agenturen bieten ihr Material dann Fachzeitschriften zur Publikation an. Dank KI sind solche Fakes und Fälschungen nun immer leichter und schneller zu fabrizieren. Davon handelt der ARD-Beitrag des Hessischen Rundfunks hr «Fake-Studien mit KI». Mit einem konkreten Experiment (siehe Kasten) dokumentiert der Beitrag, wie einfach und schnell künstliche Intelligenz eine «wissenschaftliche Studie» fabrizieren kann.

Für Fake-Publikationen wird viel Geld geboten

Hirnforscher Bernhard Sabel von der Universität Magdeburg ist Herausgeber einer anerkannten Fachzeitschrift für Neurologie. Er hat schon Erfahrungen gemacht mit einem «unmoralischen Angebot» einer solchen Fälschungsagentur. Ungeprüft sollte er einen ihrer Artikel zur Publikation übernehmen. Als Herausgeber hätte er daran Tausende Euros verdienen können, berichtet Sabel im ARD-Beitrag. Der Agenturmanager habe angegeben, bereits mit über 70 wissenschaftlichen Journalen zu kooperieren.

Sabel realisierte, dass hinter diesem Angebot System steckt. Doch es gab keine verlässlichen Zahlen über das Ausmass. Er wollte das ändern. Gemeinsam mit anderen Forschenden untersuchte er bereits als Fälschungen enttarnte Publikationen auf typische, entlarvende Kriterien. Als aussagekräftig hätten sich gefälschte E-Mail-Adressen und Spital-Absender erwiesen sowie Literaturlisten, die andere Fälschungen enthielten.

Eine wahre Fälschungs-Epidemie ist im Gange

Nach umfangreichen Abklärungen kann Sabel dem ARD-Reporter berichten: «Stand heute schätzen wir, dass mindestens hunderttausend publizierte wissenschaftliche Arbeiten verdächtig oder gefaked sind.» Das betreffe nur die Biomedizin. Hochgerechnet auf die gesamte Wissenschaft komme man auf vier- bis fünfhunderttausend publizierte, gefälschte Arbeiten jedes Jahr – bei rund 5 Millionen Publikationen insgesamt weltweit. Das ergäbe eine Fälschungsquote von rund 10 Prozent.

Als Herkunftsländer hätten sich China, Indien, Russland, die Türkei und einige arabische Länder hervorgetan. In der westlichen Welt werde der Anteil Fälschungen auf 1 bis 2 Prozent geschätzt, heisst es im ARD-Beitrag.

Falsche Studien können verheerende Folgen haben

«Unsere Wissenschaft, unser Wissen ist essenziell für den Fortschritt», sagt Psychologie-Professor Sabel. «Wenn wir nicht mehr wissen, was wahr ist und was unwahr, dann treffen wir falsche Entscheidungen.» Alle menschlichen Bereiche seien gleichermassen davon betroffen.

Jörg Meerpohl ist Direktor von Cochrane Deutschland, einem internationalen Verband zur Qualitätssicherung in der Medizin. Die Entwicklung der gefälschten Studien sei besorgniserregend, sagt er im ARD-Beitrag. «Die Implikationen für Patienten wären immens, wenn aufgrund von falschen, fiktiven Studien Behandlungsempfehlungen getroffen werden.»

In der Forschung mangelt es an Qualitätssicherung

Der Markt für Fälschungen ist deshalb so gross, weil Forschende gezwungen sind, über ihre Arbeit so viel wie möglich zu publizieren, um an Fördergelder und Aufträge zu kommen. Die Quantität stehe im Vordergrund, nicht die Qualität der Arbeiten.

Das wollten die grossen Verlage ändern, berichtet die ARD, um ihre und die Glaubwürdigkeit ihrer Fachzeitschriften zu schützen. Sie würden selbst KI einsetzen, um Fälschungen schneller zu entdecken. Doch Bernhard Sabel plädiert für ein grundlegendes Umdenken: «Wir brauchen ein Qualitäts-Bewertungssystem, um eingereichte Manuskripte unabhängig von den Verlagen zu bewerten.»

«Die Zeit eilt», kommentiert der ARD-Beitrag, denn KI werde jeden Tag besser und die Fälscher würden routinierter.

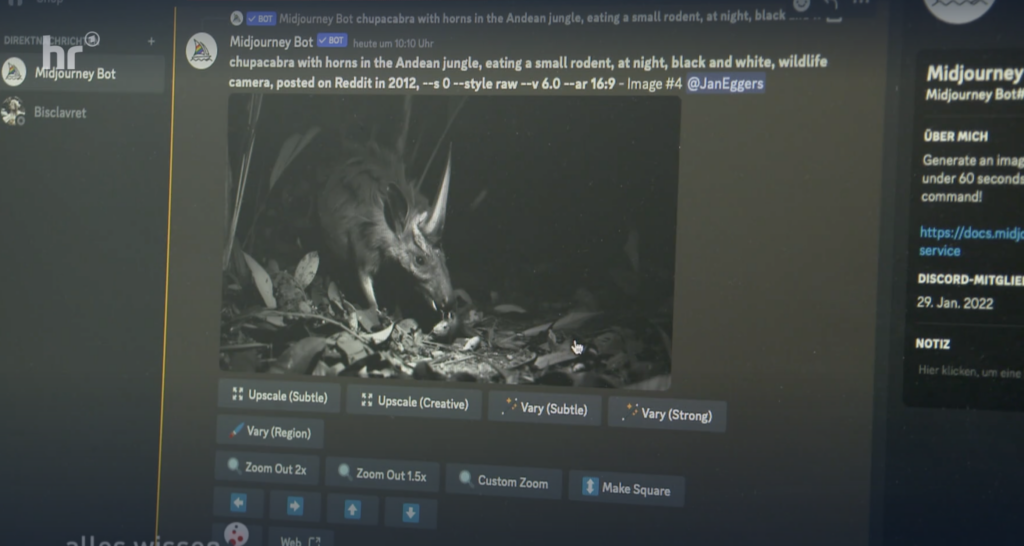

Das KI-Fälschungsexperiment des hr

Der Hessische Rundfunk beauftragte seinen KI-Experten Jan Eggers, durch den Einsatz künstlicher Intelligenz einen falschen wissenschaftlichen Artikel zu erstellen. Dieser entschied sich für eine Studie über das «Chupacabra», ein Fabelwesen, das in den Anden angeblich Schafe und Ziegen anfällt. Dieses Tier gibt es ebenso wenig wie den Yeti oder das Nessie. Doch der KI war das egal.

«Als Erstes braucht man glaubwürdige Daten», sagt Eggers im ARD-Beitrag. Diese musste er nicht selbst erfinden. Er erteilte der KI den Auftrag, solche Daten nach bestimmten Kriterien zu erzeugen. Es sollte um die Auswertung von Fotofallen-Bildern gehen: Anzahl der beobachteten Chupacabras, Art ihrer Beute etc. Den künstlich generierten Datensatz übermittelte Eggers an Chat GPT und erteilte der KI den Auftrag, damit «wie ein Wissenschaftler zu arbeiten», also einen Artikel darüber zu schreiben. Es dauerte nur kurze Zeit, und schon bekam Eggers einen ansehnlichen Artikel, klar gegliedert und in sich stimmig, samt Inhaltsverzeichnis und Zusammenfassung. Die verwendete Sprache strotzte vor zoologischen Fachbegriffen wie «alimentäre Gewohnheiten» und «variables Beutespektrum». Auf Anfrage erstellte die KI Fotofallen-Bilder, die das erfundene Tier angeblich auf seinen Beutezügen zeigten. Sogar kurze Videos solcher Szenen spukte die KI aus.

Nach seinen eigenen Erfahrungen und Versuchen schätzt der KI-Experte des Hessischen Rundfunks im Beitrag, dass «wenige Stunden reichen, um ein sehr überzeugend aussehendes Papier zu generieren.» Spezielle Kenntnisse brauche es dafür nicht. Und er bilanziert: «Unser Begriff von dem, was wir für echt halten, ist ganz massiv angegriffen.»

Themenbezogene Interessenbindung der Autorin/des Autors

Keine

_____________________

Meinungen in Beiträgen auf Infosperber entsprechen jeweils den persönlichen Einschätzungen der Autorin oder des Autors.

Würden diese Algorithmen, die man unter der Bezeichnung künstliche Intelligenz vermarktet, tatsächlich selbst lernen, würde ihnen vor allem eines von Menschen gelehrt, namentlich, dass zu lügen, betrügen und hinters Licht zu führen vollkommen okay ist.

Diese Kls lernen aber nicht wirklich, sie optimieren ihre im Grunde deterministischen

Searchalgorithmen innerhalb bestimmter Parameter und tun das sehr schnell aufgrund von (vom Menschen vorgegebenen) Daten und (vom Menschen vorgegebenen) Wertungen/Gewichtungen von (ebenfalls vom Menschen vorgegebenen) Annahmen und vermuteten Zusammenhängen. Das Resultat ist eine nicht implausibel scheinende virtuelle Realität aus dem Genre ‚Science Fiction‘, oft aber ohne Science.

Der Kommentar von Oliver Fehr bedarf keiner Ergänzung. Danke dafür! Professor Joseph Weizenbaum hat den KI-Hype schon 1976 entlarft in «Macht der Computer und die Ohnmacht der Vernunft:» Damals noch mit Bemühung um wissenschaftliche Redlichkeit. Heute ist «Science Fiction » ein schmeichelhaftes Urteil über diesen Unfug.